机器之心报道

编辑:小舟、蛋酱

开源是永远的必杀技。

自从文本到图像开源模型 Stable Diffusion 最初版本发布以来,DreamStudio 一直是 Stability AI 新模型和功能的主要界面。迄今,用户已经借助 DreamStudio 创建了数百万张图像。

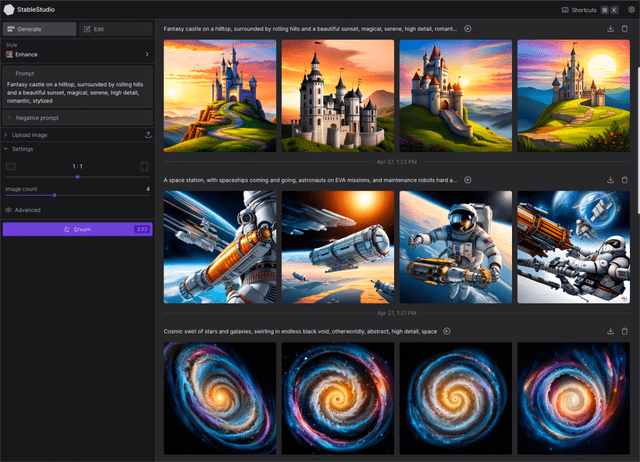

最近,DreamStudio 还升级到了 SDXL,实现了比其前身 Stable Diffusion 2.1 更详细的图像和构图,并能用较短的 prompt 来创建描述性图像。

就目前来说,DreamStudio 已经可以生成这样的图像,效果不输 Midjourney 5.1:

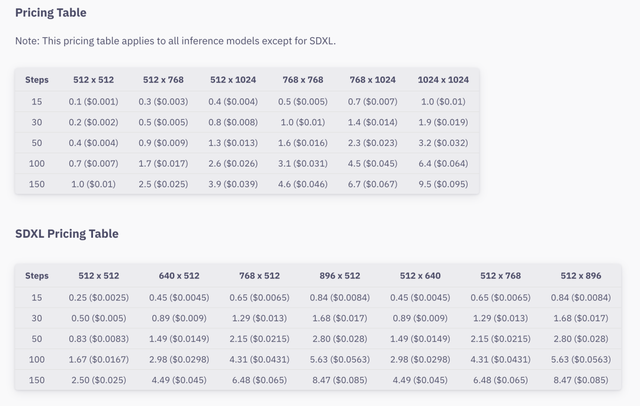

尽管 DreamStudio 提供了几乎没有门槛的图像生成方法,但它也有一个条件:付费。SDXL 版本的定价甚至还要更高一些。

而且,对一部分技术过关的开发者来说,他们也希望能够在 DreamStudio 的基础上进行一些应用扩展。

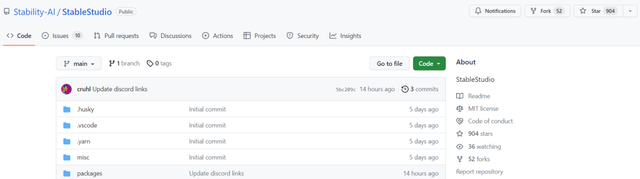

或许是听到了网友们的心声?刚刚,Stability AI 发布了 DreamStudio 的开源版本 ——StableStudio。

开源地址:https://Github.com/Stability-AI/StableStudio

「我们相信,扩大技术落地的最佳方式是通过开放、社区驱动的开发,而不是闭源产品的私有化迭代。」Stability AI 表示。

在该公司的规划中,StableStudio 的目标是进行更广泛的社区合作,为生成式 AI 打造一个世界级的用户界面,让用户能够充分控制。尽管 DreamStudio 仍将是 Stability 公司托管的 StableStudio 的实现,但最终目标是培养一个能够超越任何由单一公司开发的项目。

具体来说,StableStudio 和 DreamStudio 有什么区别?

Stability AI 做了一些调整,使得该项目对社区更加友好。包括:

扩展功能

DreamStudio 最初被设想为 Disco Diffusion 的动画 studio,2022 年 Stable Diffusion 发布之后,DreamStudio 的重点就转向了图像生成。

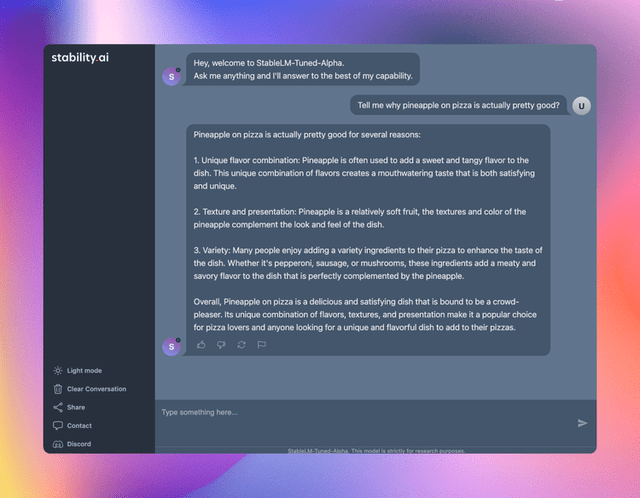

受今年爆火的对话模型启发,4 月 Stability AI 发布了开源 LLM StableVicuna。DreamStudio 的开源版本 StableStudio 将和 StableVicuna 结合,推出聊天界面。

StableVicuna 对话示例。

Stable Diffusion XL 生成的「Stable Vicuna」。

Stability AI 表示,StableStudio 未来可能会更新以下功能:

安装与使用

StableStudio 项目已在 GitHub 上线,其中包含快速安装方法。

项目地址:https://github.com/Stability-AI/StableStudio

要使用 StableStudio,用户需要先安装 Node.js 和 Yarn。然后按照如下命令克隆 StableStudio 存储库

git clone https://github.com/Stability-AI/StableStudio.git

cd StableStudio

yarn

yarn dev

默认情况下,StableStudio 在 localhost:3000 上运行。用户需要准备 API 密钥才能使用默认的 Stability API 插件;如果没有,则需要在 DreamStudio 上创建帐户并获取密钥。

图像生成主流模型

无论是 DreamStudio,还是开源版本的 StableStudio,其背后的基础模型都是当前大火的图像生成模型 Stable Diffusion。Stable Diffusion 因其能在消费级 GPU 上快速生成高质量图像而得到广泛使用。

Stable Diffusion 模型的技术最早来源于发表在 CVPR 2022 中的一篇论文《High-Resolution Image Synthesis with Latent Diffusion Models》。为了训练出 Stable Diffusion,研究团队动用了 4000 个 A100 Ezra-1 AI 超大集群, Stability AI 公司提供了这些算力。

2022 年 8 月,Stability AI 宣布发布 Stable Diffusion 并开源,11 月,他们又发布了 Stable Diffusion 2.0 版本。现在,Stable Diffusion 已取代 GAN 成为图像生成领域主流模型。