近年来,随着算法强势崛起,用户简直被“宠上了天”。比如,打开资讯类App,“爱看”的信息总是第一时间跃入眼帘;规划出行道路时,算法会把最短或最快的路线推荐给我们;点外卖时,平台会优先呈现评分高、距离近的餐馆,等等。

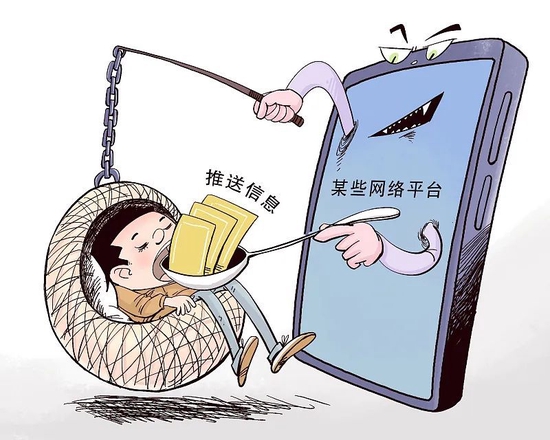

但是算法有时像是“天使”,有时像是“魔鬼”。“困在算法里”俨然成为一种新型社会焦虑,据不完全统计,当前基于算法的个性化内容推送已占整个互联网信息内容分发的70%左右。平台通过算法推荐赋予用户信息定制功能的同时,算法操纵舆论、制造“信息茧房”、滥用数据等乱象也逐渐凸显出来。

图源:视觉中国(17.650, -0.16, -0.90%)

那么,今天的我们应该以何种态度对待算法?笔者认为,规范算法推荐需谨防“五种风险”。

一防主流价值观受到算法冲击。马克思曾说过,“人们为之奋斗的一切,都同他们的利益有关。”这句话用在奉行“流量至上”的一些社交平台上再合适不过。在资本裹挟下,它们将主流价值观与网民偏好人为割裂开来,想当然地以为“高大上的内容会影响流量”,为获取流量利益不断炒作桃色、暴力等事件,导致主流价值的传播空间被大大挤压,造成网络信息“劣币驱逐良币”。

比如,一些短视频平台时常出现“卖惨营销”视频。有媒体报道,这些卖惨视频的背后,实为一条“吸引眼球—赚取流量—变现获利”的产业链,尽管这些视频述说着不同的故事,但其共性和本质仍为“求关注”“蹭热点”。

二防“信息茧房”加剧舆论失焦。网络舆论被“带怒党”引领,被“爱国爽文”收割,被水军漫灌,都不是罕见现象。当网民在平台发布热点事件的相关信息后,平台根据算法模型,将帖文迅速分发到有同样标签的“兴趣气泡”内,形成“回音室效应”,相似观点、同质化信息的叠加重复,造成话题的高热不退。

2021年,有网民称,浙江杭州一女子遭遇“敲门杀人”,并且绘声绘色地讲述“案件”发生过程,在网络上引发舆论高度关注。尽管后被证实为虚假信息,但在“信息茧房”的助力下,网民不断参与到类似标签的话题讨论中,无疑加剧了公众的紧张情绪。

图源:视觉中国

三防“吃瓜”乱象背后的黑产。“吃瓜群众”热衷于“吃瓜”,作为一种群体行为本也无可厚非,可问题在于这种“吃瓜”行为很多时候是被动的。一些内容聚合平台把算法当作“摇钱树”,为了激发用户参与讨论,那些劣质低俗,甚至是虚假、极端、刺激、煽动性的内容仿佛成了流量密码,久而久之,对国家安全和社会稳定造成严重挑战。

很多社交平台采用信息流漏斗算法,内容创作者上传内容后,平台会先投放到一个小的流量池,再根据完播、点赞、评论、转发、停留时长等指标评分,决定是否投放到更大的流量池。在这种算法机制的作用下,无形中助长了雇佣水军、刷虚假流量、集中炒作负面舆论等乱象。不法分子将“假瓜”“烂瓜”包装成“实锤”,不遗余力地调动负面因素,“靶向”推送争议性话题,加剧了舆论啸聚和群体对立。

尤其一些刑事案件的网络舆情,在网民“求安慰”“同吃瓜”等多种社交心理的作用下,经历群圈交叉传播后,产生各种“脑补”出来的“恐怖故事”,如“辽宁省中医院医生被枪杀,更多细节透露”“南宁万达茂男子捅死女友后逃跑,背后是令人警醒的真相”等。类似论调将悬疑感拉满,公众出于“猎奇”心理,迅速转向公开平台讨论,对案件细节“抽丝剥茧”,导致热点舆情难以“退烧”。

四防青少年的观念被算法带偏。如今,未成年人刷短视频上瘾成为一种社会现象。有调查报告显示,20%的青少年“几乎总是”在看短视频。短视频平台为了抢占有限的注意力,通过精准捕捉青少年的“爽点”和“痒点”,不断“投喂”无需思考的“爆米花信息”。以“极端女权”“饭圈”两个圈层为例,这类账号转载、发布的内容基本上是男女对立、追星类信息。

试想,青少年一代如果长期沉浸在消遣化、娱乐化内容的“茧房”之中,他们还会潜心思考和琢磨科学、哲学、文学、历史这些深刻问题吗?青少年的思考力一旦钝化,势必会削弱整个社会、整个民族的创造力,这不得不引起警惕。

五防美西方利用算法加剧对华认知战。算法看似一个“中立性”的工具,但它可以被政治、商业等非技术力量操纵和改变。美西方在利用社交平台算法妖魔化中国方面一直有着“不俗表现”,那些美化西方、抹黑中国的言论在推特、脸书等社交平台上往往拥有更大“被推荐”可能,从而加剧国际舆论偏见。一个比较典型的例子是,新冠疫情暴发后,国际社交平台利用算法推荐技术,将大量“无脑黑”中国的信息内容,“精准”推送给用户。

除此之外,美西方也常常“扣准”时间对我国进行隐蔽的舆论操纵,将一些普通的民生问题政治化、国际化,通过机器算法的扩大传播,将小事炒大、大事炒炸,故意将网民情绪引导到对人权保障、社会治理、体制改革等问题的抨击上来。2021年,在“成都49中学生坠楼事件”中,美西方利用机器人(11.150, 0.16, 1.46%)账号大规模转发,使之迅速形成舆情热点。

图源:视觉中国

值得深思的是,面对算法技术的种种侵蚀和“暴击”,我们应该随波逐流还是积极应对?《互联网信息服务算法推荐管理规定》的正式施行,标志着监管的靴子已然落地。人们寄希望于新规能够一展雄风,管住一度脱缰的算法,但要实现对算法的有效监管,还有一段路要走。

先说分级分类监管思路的确立。正如有学者所说,“算法决策虽然是新事物,却并非洪水猛兽,监管也要像大禹治水一样,宜疏不宜堵。如果抡起大棒乱打一气,把数字产业全都阉割了,用户也没尝到啥甜头。”所以,算法无处不在的今天,我们所需要的不是简单粗暴的“一刀切”,在“强监管”基础上还得有“细监管”。比如,不妨根据算法可能给经济社会以及个人所带来的风险程度,探索实行差异化监管,特别是将那些具有舆论属性或者社会动员能力的算法推荐服务提供者纳入严格监管,在保障用户权益的同时,也要考虑对算法发展空间的呵护。

再说网络空间“人行道”的构建。芝加哥大学法学教授凯斯·桑斯坦认为,公共领域就应该像“人行道”一样,会遇到种种非计划和不想要的情景,不同的人群会体认到新鲜体验。平台可以探索改进以机器为核心的信息分发模式,建构网络空间的“人行道”,以增加用户接触不同观点的可能性,营造理性宽容的舆论氛围,避免一言不合就陷入非理性的“骂战”。

事实上,2011年帕里泽提出“过滤气泡”的概念后,就掀起过一场声势浩大的“戳泡运动”,主要参与者为媒体、科技公司、非营利性组织,意在帮助人们开放包容地倾听全方位的声音。比如,瑞士报纸NZZ开发了一款APP,每次给读者推荐的信息中都会包含一个“惊喜”,也就是超出读者原本偏好范围之外的内容,帮助摆脱“信息茧房”的束缚。

最后说算法与人的“和谐相处”之道。说到底,把算法装进笼子里的最终目的,还是要回归到人的主体价值上来,让算法更好地为用户服务。终结算法“霸权”,要把算法的选择权利交还给用户。平台可以向用户提供便捷的关闭算法推荐服务的选项,变“平台主导”为“用户选择”。

总而言之,算法推荐就如硬币两面。我们既要清醒认识到算法的正面意义,利用算法技术和规则为社会服务,又要通过良法善治减少或避免其负面影响,这样才能更好营造风清气正的网络舆论环境。