现如今,谈起人工智能我们都会想到的是“深度学习”(deep learning),无论是战胜李世石的AlphaGo,还是能够随意写出人类水平文章的GPT-3,它们的背后都依托的是这套算法。

它具有很好的数学解释性,与现有的计算机架构完美匹配,但也存在需要大量数据训练、耗能巨大以及随之而来的产热惊人等问题,为此最前沿的研究者提出了“类脑计算”的概念,想要通过进一步模仿人类大脑的运行方式,重构计算机的底层架构,好让人工智能摆脱这种越好用成本越高的窘境。

目前,新兴的“类脑计算”还没有大规模应用,但各项研究已经取得了一定的突破,今天首席未来官特意为你梳理了“类脑计算”的底层原理,并通过与“深度学习”算法的对比,让你提前了解这个可能会颠覆未来计算机产业的新技术。

1.“深度学习”的原理

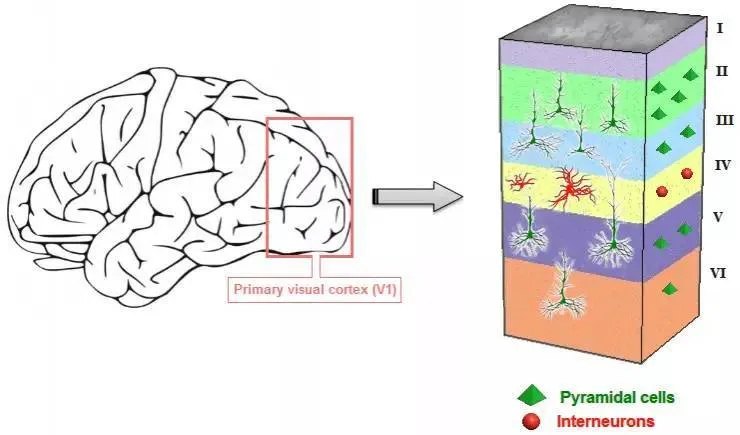

“深度学习”算法本质是对人类大脑视觉系统的模仿,因为人的视觉系统由很多层神经网络组成,层与层之间通过学习训练生成连接的通路,所以被称为“深度学习”。

深度学习算法虽然在层级上模拟了视觉系统,但受限于电脑结构中存储与运算分开的模式,做不到像人类的神经元一样将计算(神经元)和存储(突触)一体化,于是把神经元的运作方式抽象成了一个输入与输出结合的计算过程。

这就导致了原本一个神经元能够完成的任务,在计算机上需要大量的计算单位才能完成。2021年8月10日,在Neuron上发布的一项研究显示,人脑一个神经元的功能在深度算法中需要1000个以上的计算单元通过5到8层的深度网络实现。

2.先天缺陷带来的短板

由于需要大量计算单元才能实现单个人类神经元的功能,这就直接导致了深度学习要实现与人脑相似的功能复杂程度就会更高。

如今在语言模型上最强的GPT-3拥有1750亿个参数,做个简单推导也就相当于1.7亿个人类的脑神经元,而人脑的神经元个数在100亿左右,如果把人脑神经网络的复杂连接再算上,要完全模拟一个人脑出来的耗能将难以想象。

更多的计算单元也就意味着更大的能量消耗,同样拿GPT-3为例,它训练一次消耗的能量可以让一辆车在在地球与月球之间跑完一个来回,而只用来下围棋的Alpha Go仅计算单元的功率也有2000W的水平,与之相对的是坐它对面的李世石的大脑耗能只需要20W左右,是它的百分之一。

3.模仿神经元的“类脑计算”

为了解决深度学习的问题,科学家提出了进一步模拟人脑“神经元—突触”体系的“类脑计算”思路,分别从算法和硬件两方面探索打造“人工大脑”的方法。

算法层面上,目前的研究重点是“脉冲神经网络”(Spiking Neural Network,简称SNN),顾名思义就是模仿神经脉冲信号传递、运算的人工智能算法,SNN的最大优点在于,相较传统算法中每个计算单元始终处于活跃状态不同,其每个计算单元只有在接受或者发出信号时才被激活,同时它进行的只有加减运算,节省了运算资源也减小了求和量。

但脉冲本身的不连续性使得传统的人工智能训练模式并不能适用于它,所以其性能尽管理论上可以与深度学习算法相匹配,相应的训练模式还处于研究阶段。

硬件层面,类脑芯片也开始兴起,不再像传统计算机中的“冯·诺依曼架构”,把存储与计算功能分离,使得每次计算都要在内存和CPU上频繁调用数据,导致信息效率差、发热高,而是基于微电子技术和新型神经形态器件的结合,实现存储与计算的深度融合,使芯片能够进行异步、并行、低速和分布式处理信息数据,并具备自主感知、识别和学习的能力。

4.4款类脑芯片

2014年8月,IBM公司推出了第二代类脑芯片“True North”,工艺进化到了28纳米,拥有了100万个可编程神经元和2.56亿个可编程数据传输通道。

这次最大的进步在于“神经突触内核架构”,让其中每个计算核心(神经元)都拥有了本地内存,工作方式已经非常类似人脑中的神经元,总功耗降低到了第一代的1%,体积是第一代的十五分之一。

Zeroth不需要预编程,通过正向强化的方式,提供了类似人类大脑多巴胺刺激的方式,让芯片具备了从周围环境获取反馈的能力,高通用装载该芯片的机器小车进行演示,使小车在自行启发算法下完成寻路、躲避障碍等任务。

·西井科技DeepSouth芯片

西井科技是一家中国公司,已推出了两款类脑芯片,其中DeepSouth拥有5000 万类脑神经元,总计有 50 亿的“神经突触”,可以直接在芯片上完成计算,不需要通过网络连接后台服务器,可在“无网络”情况下使用。