出品|虎嗅科技组

作者|包校千

编辑|陈伊凡

题图|视觉中国

由AI target=_blank class=infotextkey>OpenAI自主开发的聊天应用ChatGPT风靡全球后,立即在全球范围内掀起了大模型开发的热潮。但准备参战的玩家们很快便认清现实,这不过是一场由巨头主宰的游戏,其中的关键,就是能耗。

知名计算机专家吴军的形容并不夸张——ChatGPT每训练一次,相当于3000辆特斯拉的电动汽车,每辆跑到20万英里,约32.19万公里。而普通家用汽车年均行驶里程在1.5万公里左右,ChatGPT每训练一次,就相当于3000辆特斯拉在一个月走完了21年的路。

即便是对大模型跃跃欲试,准备“带资入组”的大佬,也不得不掂量下:腰包里的银两,究竟够花多久?

过去一年,OpenAI的总支出是5.44亿美元。国盛证券估算,GPT-3的单次训练成本就高达140万美元,对于一些更大的LLM(大型语言模型),训练成本介于200万美元至1200万美元之间。

其中,“大模型训练成本中60%是电费,”华为AI首席科学家田奇在近日一场AI大模型技术论坛上强调,电力的降本增效已迫在眉睫。如果大模型普及,全球飞速运转的服务器,怕不会把地球烧了。

既然大模型训练的成本中,电费占主要部分,那么究竟是哪些环节在耗电?又能如何优化?

大模型是“电老虎”

OpenAI曾在其《AIandCompute》分析报告中指出,自2012年以来,AI训练应用的电力需求每3个月到4个月就会翻一倍。根据田奇给出的数据,AI算力在过去10年至少增长了40万倍。其中,拉高AI大模型能耗的一大要因,就是参数训练集的规模。

OpenAI首席执行官SamAltman在接受公开采访时表示,GPT-3的参数量为1750亿。最近发布的GPT-4 参数量是GPT-3的 20 倍,计算量是GPT-3的10倍。最快于2024 年底发布的GPT-5 ,参数量将达到GPT-3的100 倍,计算量将飙升至200到400倍。

根据斯坦福人工智能研究所(HAI)发布的《2023年人工智能指数报告》,训练像OpenAI的GPT-3这样的人工智能模型所需消耗的能量,足可以让一个普通美国家庭用上数百年了。GPT-3是目前大模型中有据可查的第一大“电老虎”,耗电量高达1287兆瓦时。

公司模型参数量PUE电力消耗DeepMindGopher280B1.081066MWhHugging FaceBLOOM176B1.20433MWhOpenAIGPT-3175B1.101287MWhMetaAIOPT175B1.09324MWh

数据来源:Luccioni et al., 2022,虎嗅制图

即使是由人工智能初创公司 Hugging Face 搭建的更为高效的BLOOM模型,耗电量也达到433兆瓦时,足以为一个普通美国家庭供电41年。

参数训练集的规模,是拉高大模型能耗的主要因素。其中AI处理器和芯片,是产生能耗最主要的地方,一位信息和通信技术从业者告诉虎嗅,CPU 和GPU 的功耗通常占服务器整机的80%。不过和普通服务器750W到1200W的标准功耗相比,AI服务器由于配置多个系统级芯片,在运行AI模型时会产生更多的能耗。

以英伟达DGX A100服务器为例,搭载8颗A100 80GB GPU,最大系统功耗达到6500W,外形尺寸为6U,考虑42U的标准机柜,则单机柜可放置7个DGX A100服务器,对应功耗为45.5KW。

按照ChatGPT在今年1月日均1300万的UV标准,OpenAI需要3万多张A100 GPU,初始投入成本约为8亿美元,折算下来的电费每天是5万美元左右。

“如果大模型的使用者越来越多,为了保证时延,需要追加服务器订单,来提供更多的基础算力。假设有10万用户的并发计算量,差不多要30万到40万张GPU才够。”某头部数据中心业务负责人推算道。

数据显示,ChatGPT的总算力消耗约为3640PF-days,这需要七到八个投资规模30亿、算力为500P的数据中心才能支撑运行。根据半导体行业资讯机构SemiAnalysis估算,未来如果让ChatGPT承担谷歌搜索的全部访问量,至少也需要410万张英伟达A100 GPU。

OpenAI训练其模型所需的云计算基础设施规模是前所未有的,比业内任何人试图构建的GPU算力集群都要庞大

目前,微软在六十多个Azure数据中心部署了几十万张GPU,为ChatGPT提供超强算力。作为OpenAI最大的投资方,微软拿到了云计算基础设施的独家供应权,并开始下一代AI超级计算机的开发工作当中,数万张英伟达A100 GPU以及新一代H100 GPU都将被导入其中。

前所未有的算力规模,连业内专家都在感慨,这是一件多么疯狂的事。

AI引发新技术革命

疯狂的事,催生更疯狂的想象力。

眼下,就连呼吁暂停大模型开发的马斯克,也要打造“推特版的ChatGPT”了。

根据美国知名科技媒体Business Insider 报道,马斯克已经购买了一万块GPU,通过生成式的AI大模型和海量数据,强化推特的搜索功能并帮助其广告业务重整旗鼓。

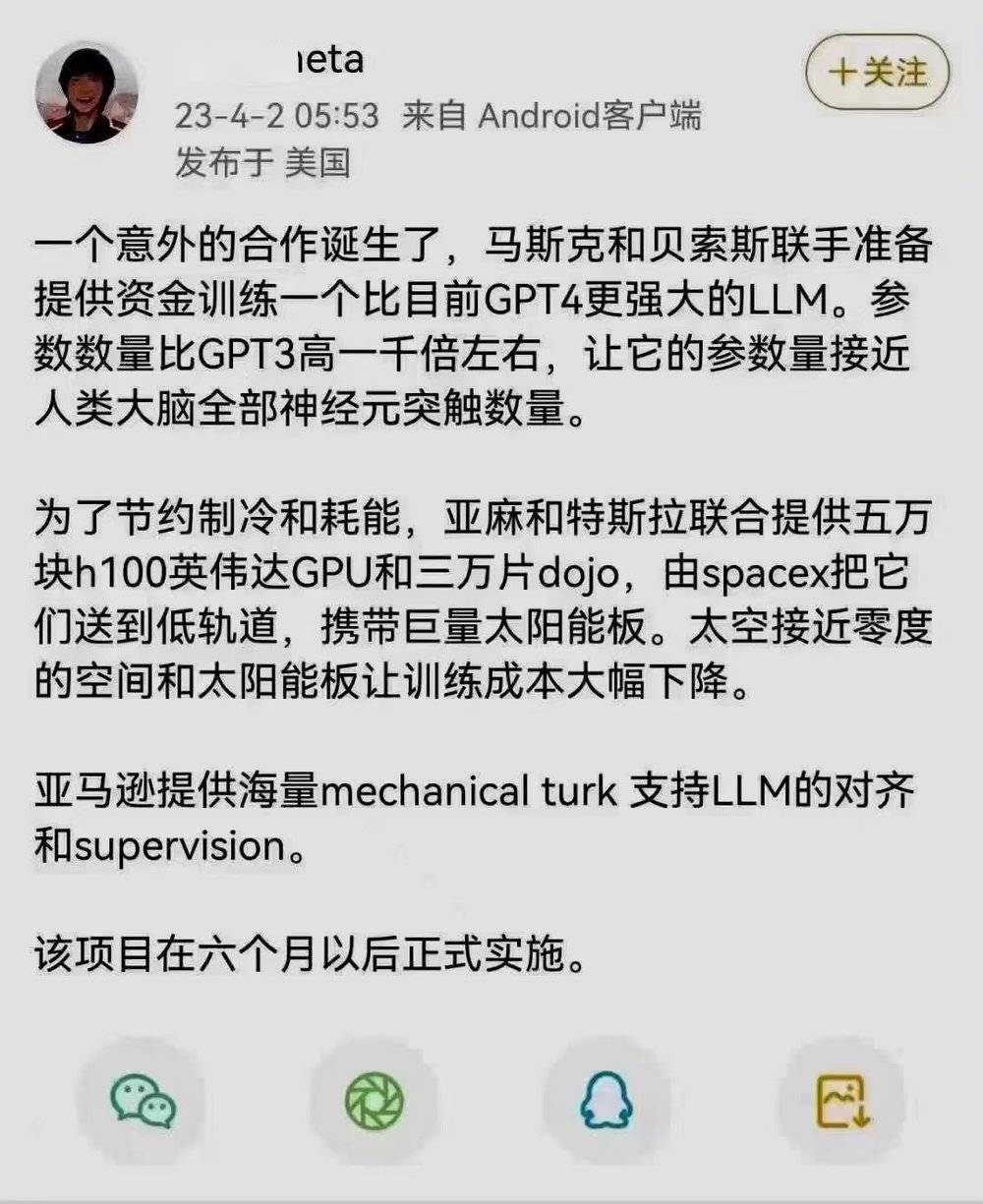

作为OpenAI的早期投资人,外界一直对马斯克抵制AI发展的态度半信半疑。就在本月初,网络上还有传言称马斯克将在半年后打造比GPT4更强大的大模型。

更有传言称,马斯克计划通过SpaceX把超级计算机搬到太空上,目的是节约制冷和耗能。且不论这件事的真假,看起来倒是个好点子。

截图来自网络

打造太空数据中心,似乎能享有得天独厚的资源禀赋:24小时天然低温散热,全年无限量太阳能,而且全部都免费。那么这个绝妙的创意,到底靠不靠谱?

一位民营商业航天专家否定了这个想法,他告诉虎嗅,太空超低温环境确实不假,但很多人忽略了一个基本的物理常识,那就是所有热量的交换都是靠分子运动实现的。而太空环境趋近于真空,所含物质过于稀少,因此,“虽然温度低,但是导热慢,自然散热条件其实远不如地面。”

其次,目前卫星太阳能帆板的供电系统普遍功率只有1200W,无论是电力供应还是成本,地面光伏解决方案都有绝对的优势。

另外,训练大模型需要大量的数据输入和输出,这要求服务器具备超高的网络带宽能力。太空信息基础设施提供商艾可萨联合创始人王玮认为,数据中心作为网络互联底座,保证数据传输的稳定性和速率至关重要。但就目前来看,“即便消耗星链全部的带宽,都未必都能保证大模型训练所需的数据实时传输需求。”

当然,还有一些革命性的技术创新被ChatGPT带火,中科创星创始合伙人米磊表示,最典型的就是光子技术。比如具备高算力、低能耗优势的光电共封装(CPO)技术。简而言之就是将光器件和交换芯片封装在一起,为暴涨的算力需求提供了一种高密度、高能效、低成本的高速互连解决方案。

米磊认为,本轮大模型领域的热潮代表了“AI技术的发展进入了全新阶段”。作为一种用光进行运算的芯片,其耗电量仅占同等级电子芯片的六分之一。随着人工智能不断发展,训练、运行这些产品需要的算力水平也越来越高,行业对高速率、低能耗的光芯片也越发期待。

截至目前,中科创星在光电领域累计投资了超过150家企业。早在2016年米磊就提出,光是人工智能的基础设施,光子是新一代信息技术基石的理念。“喊了这么多年,冷门的技术终于被ChatGPT带火了。”最近二级市场上光芯片相关股票的大涨也体现出了这一点。这种偶然性,在米磊看来是必然趋势。

着眼于当下,降低AI模型整体能耗、节省电费开支的主要方式,依然是想办法提高数据中心的散热效率。中金公司认为,以液冷技术为代表的主动散热技术有望凭借优良的散热性能被更多地采用。

相较于传统的风冷系统,液冷系统直接将热负荷传递至冷冻水系统中,制冷效率更高且占地更小,能够提升服务器的使用效率及稳定性,满足高功率密度机柜的散热要求。

例如英伟达HGX A100采用的直接芯片(Direct-to-Chip)冷却技术,在机架内直接整合液冷散热系统,取代传统的风冷系统散热,实测消耗的能源减少了约30%。而液冷数据中心的PUE(电源使用效率)能达到1.15,远低于风冷的PUE 1.6。

随着大模型对算力的渴求,市场对高性能芯片的需求还将进一步提升。新思科技全球资深副总裁兼中国董事长葛群就曾表示,到2025年全球数据中心占整个全球用电量将要提升到全球的20%。“因此,在全球最领先的科技公司中,最重要的一项技术方向就是如何能够使他们的数据中心能耗降低,成本降低。”

早在7年前,作为全球EDA(电子设计自动化)和半导体IP领域龙头的新思科技就启动了一项叫做“高能效设计”的项目,将芯片的能效最大化。

这种能耗管理的逻辑是,数据中心有多块芯片,每个芯片上有几十亿甚至上百亿的晶体管,一个晶体管,相当于一个用电单位,以此推断,一颗指甲盖大小的芯片,就是一个规模庞大的能源网络。如果能够将每个晶体管的能耗优化,那么最后的节能就能辐射到整个数据中心。

一位资深分析师人士坦言,市场大可不必对大模型的能耗问题过度担忧。“很多人忽略了一个事实,那就是大模型对算力的需求未来必然会逐渐下降,这意味着能耗也会相应降低。”例如,微软刚刚宣布开源的DeepSpeed-Chat就充分印证了这一点。

据了解,DeepSpeed-Chat是基于微软 DeepSpeed 深度学习优化库开发而成,具备训练、强化推理等功能,并使用了RLHF(基于人类反馈的强化学习)技术,可将训练速度提升15 倍以上,算力成本大大降低。比如,仅凭单个 GPU就能支持一个130亿参数的类ChatGPT模型,训练时间也只需要 1.25 小时。

与此同时,该分析师补充说,未来算力的分布结构一定会朝着分布式、去中心化的方式演进,即训练过程在云端完成,在边缘和端侧重推理。“而不会像现在一样,所有的压力全部由超算中心承担。”

正在改变与想要改变世界的人,都在虎嗅App