编译 | 言征

最近,ChatGPT Plus 的用户一直反映该平台及其底层 LLM (GPT-4) 的性能严重下降(编程准确率也暴降13%)。

这是继最近一系列更新之后的结果,包括为 Plus 订阅者提供网络浏览和扩展插件访问权限。在这些更新之后,该服务的工作量大大增加,人们开始注意到 GPT-4 异常快速的响应时间突然变得不那么令人“惊艳”了。

如果功能和性能受到限制,那么有些人开始取消他们的 Plus 订阅当然是有道理的。许多人将转向开源 AI 语言模型,似乎成了无声的回应。

目前对此,不少猜测和假想充斥在有关社区。有一些较为流行的观点:ChatGPT 明显的性能下降可能来自“模型的缩放痛苦”,即,降低 GPT-4 的推理能力似乎是平衡响应速度的一种可能的解决方法,对于 OpenAI 的开发人员来说,这是一个不难想到的解决方案。

还有评论指出,尽管互联网接入带来了额外好处, 最近甚至发现 OpenAI 的 GPT-4 在速度方面优于 Azure 的 GPT-4 模型,但 ChatGPT 的编码输出已经出现严重降级。

再一个原因,近期,Sam Altman 和其他科技巨头最近挺身而出,声称他们需要防止“AI 灭绝的风险”。这样看来,ChatGPT 的推理和可用性下降,似乎与 AI 行业领导者承认“人工智能,尤其是新兴的 AGI 的潜在危险性”的时间相吻合。

可能是由于 OpenAI 出于对安全性考量而对其所进行的过度 AI 对齐。简单来说,AI 对齐就是确保人工智能系统的目标与人类价值观一直,使其符合设计者的利益预期,不会产生意外的有害后果,例如输出涉及种族、政治等敏感信息。

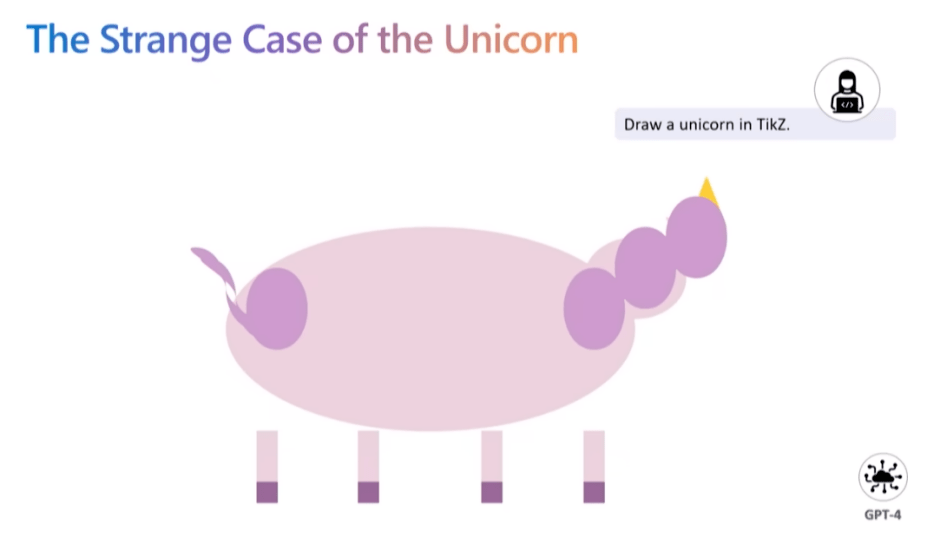

而就在近期,由微软研究院发布的一篇论文中提到了这样的观点:对 AI 模型所进行的任何 AI 对齐,都会损失模型的准确性和性能。论文主要作者 Sebastien Bubeck 在一次发言中叙述了大模型经过 AI 对齐后所出现的问题。当接收到“利用 TikZ 绘图工具绘制独角兽”的指令后,未经 AI 对齐的 GPT-4 模型给出了这样的结果。

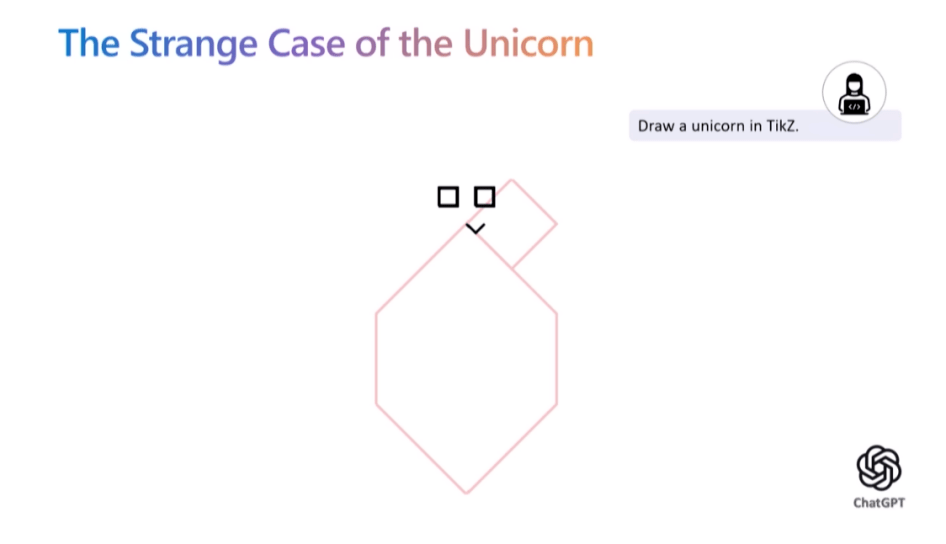

然而当实验员将相同需求提供给集成 GPT-4 模型并进行了安全性 AI 对齐的ChatGPT 后,图像的输出质量却下降了一大截。对此,Sebastien Bubeck 解释称,相较于 GPT-4,ChatGPT 利用了更多基于人类反馈的强化学习来构建护栏,然而根据古德哈特定律,奖励模型并不是一个完美的代理,因此过度的 AI 对齐会阻碍模型对任务理解的真实程度。

上周,Humanloop 的 CEO Raza 与 Sam Altman 和其他 20 位开发人员坐下来讨论 OpenAI 的 API 及其产品计划。Sam 非常开放,热情讨论了许多有关 OpenAI 很尖锐的问题。以下是要点:

1.OpenAI 目前严重受 GPU 限制

整个讨论中出现的一个共同主题是,目前 OpenAI 非常受 GPU 限制,这推迟了他们的许多短期计划。最大的客户抱怨是关于 API 的可靠性和速度。Sam 承认他们的担忧,并解释说大部分问题是 GPU 短缺造成的。

更长的 32k 上下文还不能推广给更多人。OpenAI 还没有克服注意力的 O(n^2) 缩放,因此虽然看起来很有可能他们很快就会有 100k - 1M 令牌上下文窗口(今年)任何更大的东西都需要研究突破。

微调 API 目前也受到 GPU 可用性的瓶颈。他们还没有使用适配器或LoRa等高效的微调方法,因此微调的运行和管理需要大量计算。将来会更好地支持微调。他们甚至可能举办社区贡献模型的市场。

专用容量产品受 GPU 可用性的限制。OpenAI 还提供专用容量,为客户提供模型的私有副本。要获得这项服务,客户必须愿意预先支付 10 万美元。

2.OpenAI 的近期路线图

Sam 分享了他所看到的 OpenAI 的 API 临时近期路线图。

2023

(1)更便宜更快的 GPT-4——这是他们的首要任务。总的来说,OpenAI 的目标是尽可能降低“智能成本”,因此随着时间的推移,他们将努力继续降低 API 的成本。

(2)更长的上下文窗口——在不久的将来,上下文窗口可能高达 100 万个 token。

(3)F.NETuning API——微调 API 将扩展到最新的模型,但具体形式将取决于开发人员表示他们真正想要的东西。

(4)有状态的 API——当你今天调用聊天 API 时,你必须反复传递相同的对话历史并一次又一次地为相同的令牌付费。将来会有一个记住对话历史记录的 API 版本。

2024

(5)多模态——这是作为 GPT-4 版本的一部分进行演示的,但在更多 GPU 上线之前不能扩展到所有人。

3.插件“没有 PMF”并且可能不会很快出现在 API 中

许多开发人员对通过 API 访问 ChatGPT 插件很感兴趣,但 Sam 表示他认为这些插件不会很快发布。除了浏览之外,插件的使用表明它们还没有 PMF。他建议很多人认为他们希望他们的应用程序在 ChatGPT 中,但他们真正想要的是他们应用程序中的 ChatGPT。

4.OpenAI 将避免与他们的客户竞争——除了 ChatGPT

不少开发人员表示,当 OpenAI 可能最终发布对他们具有竞争力的产品时,他们对使用 OpenAI API 进行构建感到紧张。Sam 表示 OpenAI 不会发布 ChatGPT 以外的更多产品。他说,伟大的平台公司拥有杀手级应用程序的历史由来已久,而 ChatGPT 将允许他们通过成为自己产品的客户来改进 API。ChatGPT 的愿景是成为工作的超级智能助手,但还有许多 OpenAI 不会触及的其他 GPT 用例。

5.需要监管,但也需要开源

虽然 Sam 呼吁对未来的模型进行监管,但他认为现有模型并不危险,并认为监管或禁止它们将是一个大错误。他重申了他对开源重要性的信念,并表示 OpenAI 正在考虑开源 GPT-3。他们尚未开源的部分原因是他怀疑有多少个人和公司有能力托管和服务大型 LLM。

6.大模型定律仍然成立

最近有很多文章声称“巨型 AI 模型的时代已经结束”。这并不准确。OpenAI 的内部数据表明,模型性能的比例定律继续存在,使模型变大将继续产生性能。

没错,扩展的速度无法维持,因为 OpenAI 在短短几年内就将模型放大了数百万倍,而这种做法在未来将无法持续。这并不意味着 OpenAI 不会继续尝试让模型变得更大,这只是意味着它们的规模每年可能会增加一倍或三倍,而不是增加许多数量级。

扩大规模继续起作用的事实对 AGI 开发的时间表具有重大影响。大模型假设是这样一种想法,即我们可能拥有构建 AGI 所需的大部分内容,并且大部分剩余工作将采用现有方法并将它们扩展到更大的模型和更大的数据集。如果大模型时代已经结束,那么也就意味着 AGI 离我们更远了。也就是说,大模型定律继续成立的事实,强烈暗示了更短的 AGI 时间表。