揭开大模型“混元”的面纱两个月后,10月26日,腾讯混元迎来第一次“批量上新”,并且对外开放。

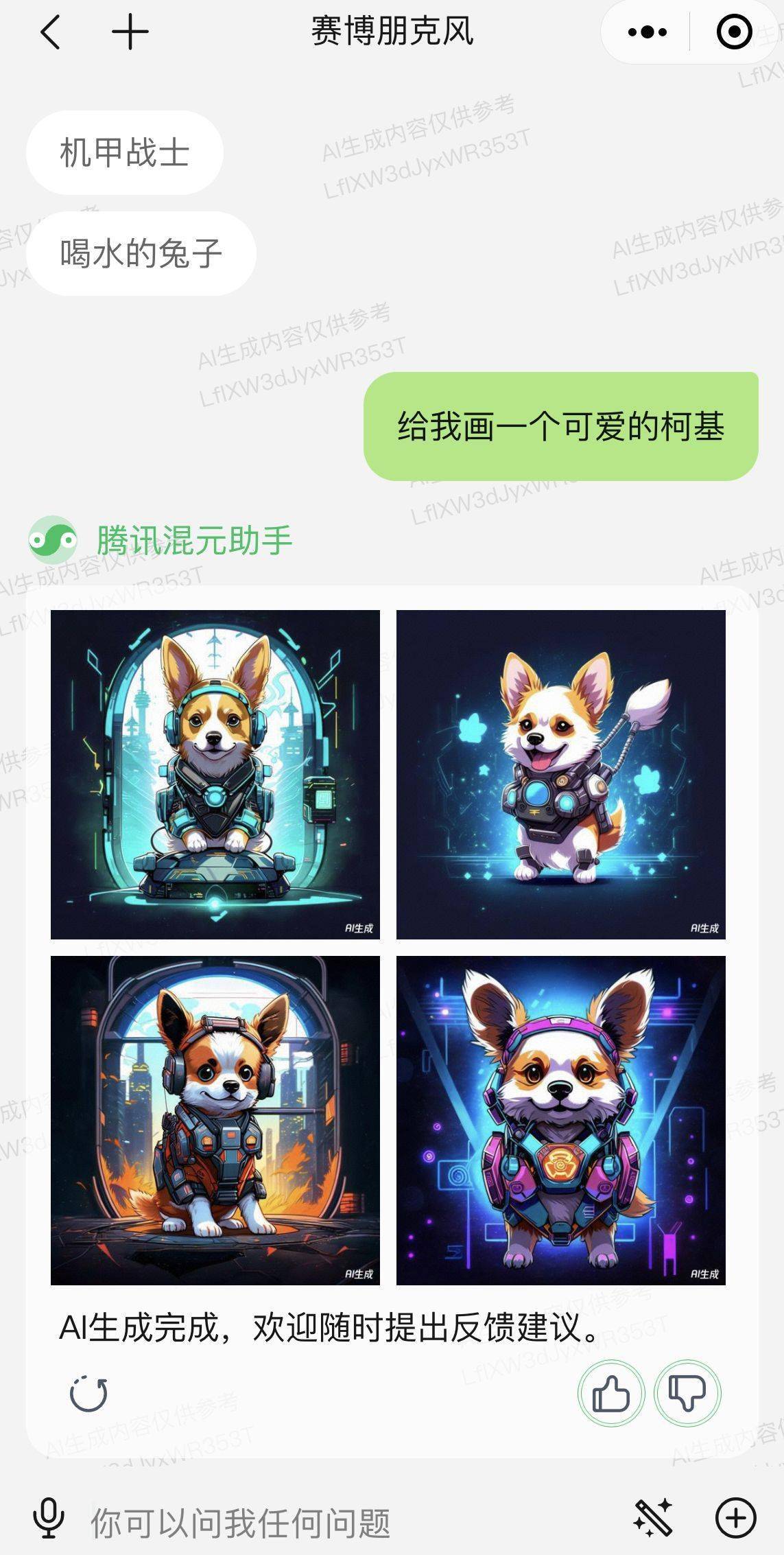

首先,通过测试申请的用户,都能够在“混元”上画画了——从生成图像的准确度、美观度而言,如今混元搭载的“灵感”模块,已经能生成相当合理、逼真的图像。

文生图是AIGC领域的核心技术之一,也是体现通用大模型能力的试金石,对模型算法、训练平台、算力设施都有较高的要求。在用户侧,这又是一个和广大用户联系紧密的应用入口。

智能涌现尝试用简单的指令让混元画图,生成速度基本在10秒左右,效果可以说风格各异,细节比此前更为丰富。

来源:混元助手

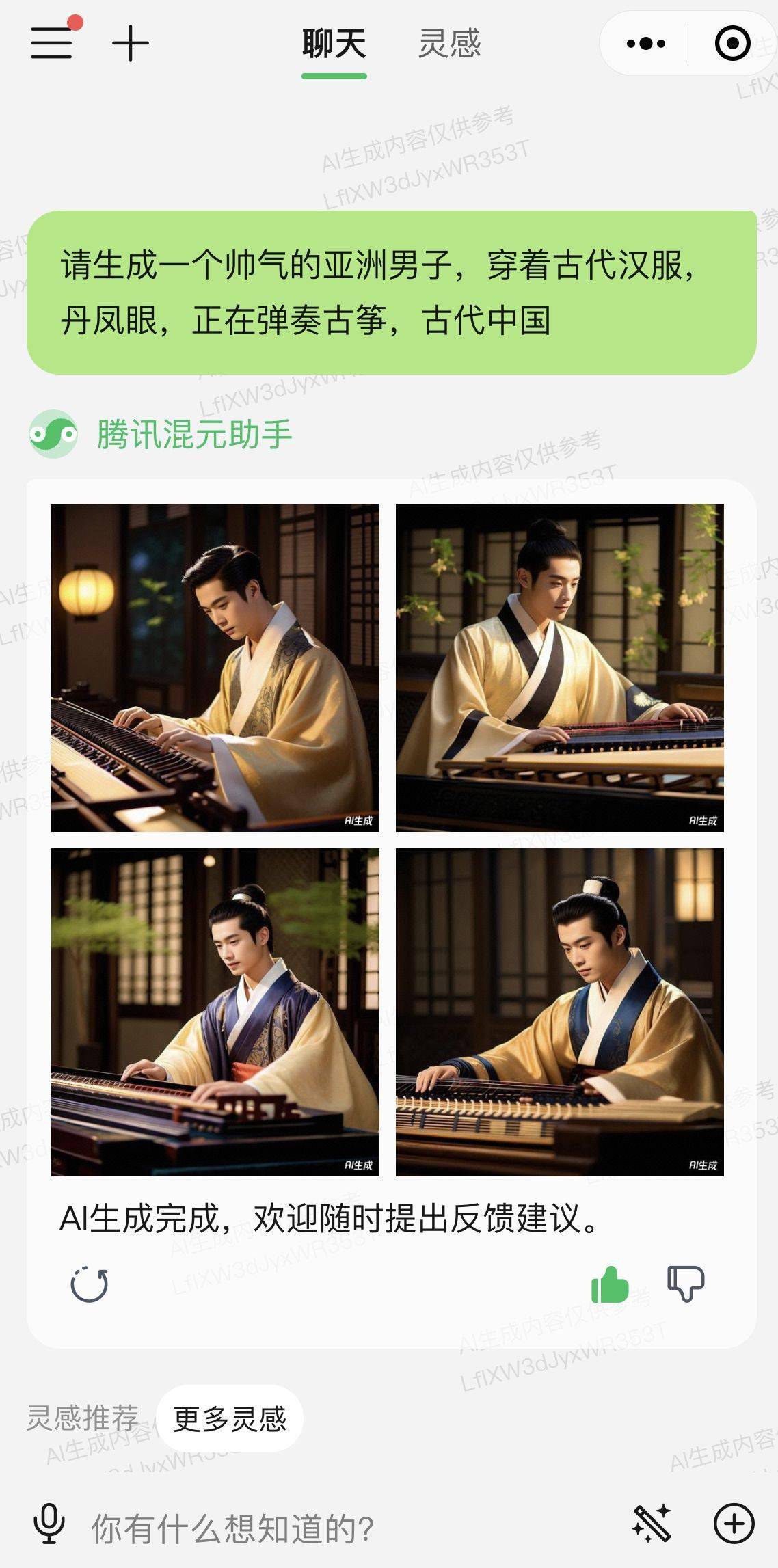

如果指令更复杂一点呢?

手部细节是可以说是文生图的一个难点。但在输入弹奏古筝的指令后,如图所见,手部细节可以说比较逼真,没有出现多指、扭曲等问题。

来源:混元助手

文生图能力升级:不仅要美,更重要的是“对”

这两个月,混元在文生图领域的技术研发目标,用一句话可以总结:“AI图像不仅要美,更重要是的是‘对’。”腾讯混元大模型文生图技术负责人芦清林表示。

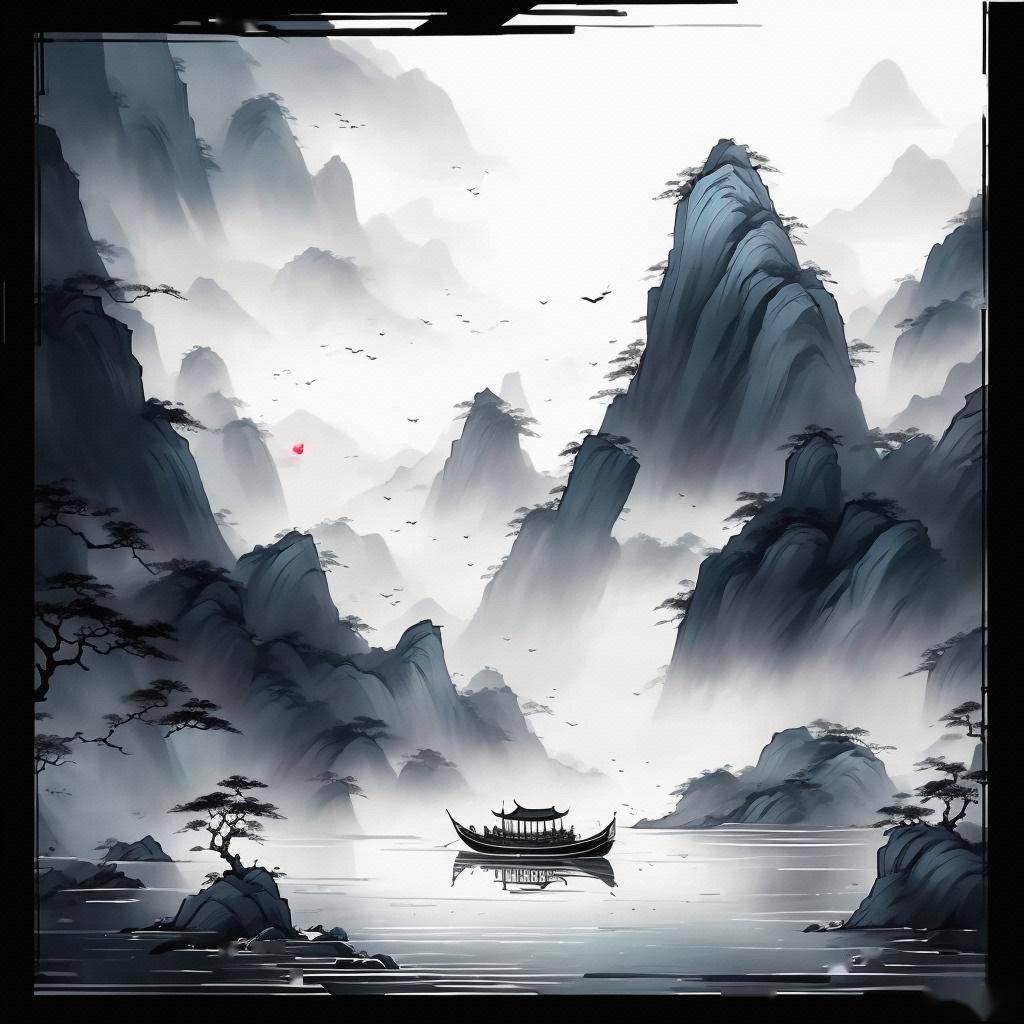

首先要把用户的指令理解对。在大模型的指令上,混元如今对中文里的意象理解也有所进步,采用了中英文双语细粒度的模型,同时建模中英文进行双语理解。比如,输入“轻舟已过万重山,水墨画风格”,就可以得到下面的图片:

来源:混元

能画得更“对”,也来源于腾讯在训练过程中的一些算法创新。

“在人像上的生成合理性上,我们把人物区分成肢体和手的数据,以及人体的骨架信息都加入到训练中,而手指头生成的局部情况也用了多种形式控制,这样畸形率会比较低。”腾讯混元大模型文生图技术负责人芦清林表示。

而画面细节的提升,来自多种因素的总和,比如人物衣服褶皱、色彩层粗等等——混元用多模型融合的方式,来对其进行提高。

以前,文生图产品用的常规扩散模型是基于CNN等技术架构,特点是比较局部,对整体的结构和刻画能力没有那么强。但现在,混元是基于扩散模型和Transformer架构相结合,可以刻画更多细节,而且对空间位置的定位能力也有加强。

“目前在人像的优化上,比如头发、皱纹,我们的效果提升了30%,在场景模型,比如草木、波纹,效果提升25%。”芦清林估算。

超过180个腾讯业务接入,为广告提效显著

除了千亿参数的主模型,腾讯混元此次也释出了7B、13B等中小模型,主要面向垂直业务。

腾讯机器学习平台负责人康战辉表示,目前千亿级别的混元模型训练,涉及了超过了2.5T的数据。而最近一个多月,混元大模型能力提升比较大的在代码能力以及数据推理,效果较此前有20%的提升。并且,对话上下文窗口,也从原来的4K,中小模型可以长至16K。

而第三季度,可以说是国内大模型领域的关键节点——包括百度、讯飞在内的各家厂商都不约而同地汇报对标GPT-3.5的进展。

在这个层面,腾讯表示,如今混元的千亿级主模型,中文效果整体超过GPT3.5,而7B/13B中小模型实测效果整体优于国内外开源模型,如LLaMA2等。

康战辉尤其指出了压缩比这一参数——同等效果下,混元仅需较少的tokens,训练效率更高。如今,基于,基于探真技术,混元大模型的幻觉率也下降了30%-50%。

而基于这些模型,大模型接入业务的形式既有API接入,也有基于混元进行精调后再部署。

在9月刚发布时,腾讯只有约60个业务接入,但两个月之后,这个数字变成了180个。

腾讯内部各种类型的业务,可以看作大模型落地的切面。

腾讯机器学习平台负责人康战辉表示,其中60多个业务是基于混元做精调,比如腾讯会议、腾讯文档、企业微信、腾讯广告等。

而能落地的功能也越来也多。比如最近,QQ浏览器就基于腾讯混元推出了“PDF阅读助手”,具备智能摘要、智能问答和多轮提问等功能。

可以看出,大模型落地已经到了一个新阶段。业内对大模型落地的讨论,也已经从参数量,进一步到更具体的模型选型——用大模型还是小模型?如何更切实地降低模型应用成本?

康战辉介绍,当前腾讯内部业务的应用很多还是以效果为主。但每个业务都会根据自己的实际情况和场景,来选择合适模型。“比如广告肯定要兼顾成本,这是很复杂、务实的选择。”

目前,已有来自零售、教育、金融、医疗、传媒、交通、政务等多个行业的客户,通过腾讯云调用腾讯混元大模型API,应用领域涉及智能问答、内容创作、数据分析、代码助手等多个场景。这些业务里,既有使用千亿模型,也有采用小模型,或者混合模型模式。

其中,腾讯广告既是腾讯的核心业务之一,在大模型应用上也是走在前列的业务。

最早,腾讯就在广告场景进行AI自动生成图像的探索,如今腾讯混元的文生图在人像真实感、场景真实感上有比较明显的优势。

“对包括传统广告的素材、创意生成、广告链路推荐等等,如今我们也能用混元来进行生成。”康战辉说。

而通过实测数据不断迭代,相较Midjourney等文生图的标杆模型,混元对广告业务的提升已经有明显优势。“经过几个月的攻坚,我们比MJ在广告场景的应用明显好一些,评测的goodcase率要比MJ高10个点左右,广告主测评采纳率混元比MJ高48%。”康战辉透露。

另外,混元代码、数学能力大幅提升后,当前也已经能在软件研发、学习等环节提供更多帮助。当前,腾讯混元代码处理水平提升超过20%,代码处理效果在实测中高于ChatGPT 6.34%,在HumanEval公开测试集指标上超过Starcoder、Codellama等业界头部开源代码大模型。

只需输入简单的指令如“帮我用前端语言实现一个贪吃蛇”,腾讯混元便能自动生成可运行的代码,快速制作出一个贪吃蛇小游戏。

来源:腾讯

此外,腾讯混元还支持Python/ target=_blank class=infotextkey>Python、C++、JAVA、Java等多种语言的指令生成,比如输入“用Python画红色的心形线”,腾讯混元也会提供代码库选择、安装命令、绘制代码等具体操作步骤的指引。

目前,腾讯内部已经有多个开发平台接入了腾讯混元大模型,工程师们可以使用腾讯混元来进行代码生成、代码补全、代码漏洞检测和修复、表格数据处理、数据库查询等工作。