文/王吉伟

阻碍广大企业应用大语言模型(LLM,Large Langeuage Models)的诸多因素中,无疑数据安全是最重要的。

3月份ChatGPT发生了用户隐私数据泄露事件,AI target=_blank class=infotextkey>OpenAI声明由于开源代码库中存在一个漏洞,使得部分用户能够看到另一个用户的聊天标题记录,并把ChatGPT短暂下线紧急修补了此漏洞。

此事件,让大家认识到大模型并不是“大安全”。

更要命的,是用户使用LLM时会不经意输入敏感数据。仅在三月份,三星内部就发生了三起误用及滥用ChatGPT案例,其中两起关于三星半导体设备,一起关于三星内部会议内容。

以致有网友调侃,三星再多几次敏感数据泄露,ChatGPT就能教大家制造先进芯片了。

在三星等多家企业出现事故后,很多企业都意识到了LLM使用可能造成的数据泄露问题。就在5月份,苹果公司也限制员工使用ChatGPT和其他外部AI工具。当然,苹果公司也在开发自己的LLM产品。

不只是苹果公司,摩根大通、美国电信运营商Verizon等公司都已经宣布禁止使用ChatGPT等应用,亚马逊也希望工程师们使用内部AI工具。

就在11月10日,投资了OpenAI并为广大企业提供OpenAI云服务的微软,因为担心公司机密数据泄露,竟然也开始禁止员工使用ChatGPT,建议员工使用自家的Bing Chat工具。

出于数据安全忧虑,美国银行、花旗集团、德意志银行、高盛集团等多家金融机构已经禁止员工使用ChatGPT聊天机器人处理工作任务,日本的软银、富士通、瑞穗金融集团、三菱日联银行、三井住友银行等企业,同样限制了ChatGPT和类似聊天机器人的商业用途。

现在,这些企业有的与OpenAI合作进行了私有化部署,有的已经研发了自有大语言模型。

数据泄露对企业的危害

多家机构如此重视,人为数据泄露到底能为企业造成多大伤害?

数据安全公司Cyberhaven曾在一个报告中,调查了不同行业客户160万员工的ChatGPT使用情况。

报告数据显示,自ChatGPT推出以来至3月21日,8.2%的员工曾在工作场所使用过ChatGPT, 6.5%的员工曾将公司数据粘贴其中;仅3月14日一天,每10万名员工就平均给ChatGPT发送了5267次企业数据。尤其是敏感数据,占到员工粘贴到ChatGPT的数据的11%。

这意味着,ChatGPT的使用率越高,敏感数据泄露的也就越多。

试想如果不加限制地使用LLM,随着更多敏感数据被传输LLM服务器,并被用作模型训练数据集,也就意味着竞争对手通过随意的聊天对话就能获悉了你的核心数据。如果竞对用这些数据建模对你进行降维打击,会对企业会造成多大损失?

数据泄露会造成严重的企业的信任度降低,让业务连续性受到影响,并可能会带来一定的法律责任。

看到这里,你就应该明白为何大型企业都在构建自有大语言模型了。

当然,凡事皆有利弊。虽然对话式交互的生成式AI会造成敏感数据泄露,但AI和自动化的使用,整体上正在降低数据泄露的成本。

IBM的《2023年数据泄露成本》全球调查数据显示,广泛使用人工智能(AI)和自动化的组织受益,平均节省了近1万美元的数据泄露成本,并将数据泄露识别和遏制速度加快了8 天。

也就是说,只要恰当使用LLM,注意安全防控,它会对企业的增效降本起到明显的作用。

LLM泄露数据的几个原因

想要实现LLM的安全使用,需要分析数据泄露的相关因素。

从已经发生的实践案例来看,造成ChatGPT等LLM数据泄露的主要原因,大概有以下几点:

1、用户隐私泄露:在使用ChatGPT进行客户服务时,企业通常需要获取用户的个人信息,如姓名、地址、电话等。这些信息一旦被未经授权的第三方获取,便可能导致用户隐私泄露。

2、内部安全风险:ChatGPT作为一款人工智能语言模型,其生成和处理的敏感信息可能包括企业内部的商业机密、计划、策略等。如果这些信息被恶意利用,可能会对企业造成严重损失。

3、系统漏洞:尽管ChatGPT具有强大的技术实力,但其系统仍可能存在漏洞。如果黑客利用这些漏洞入侵企业服务器,便可能导致数据泄露。

理论上,只要我们针对性的解决这几个问题,LLM的安全使用也就不在话下。

现在,很多引入LLM的企业基本都建立了风控机制,按照LLM使用流程的先后顺序,这些机制包括加强安全培训、定期审查系统、加密处理敏感信息、使用可靠的人工智能服务提供商、建立应急预案等。

在这些安全措施中,大家会发现“使用可靠的人工智能服务提供商”这一点最为重要,毕竟引入一个具备高度安全机制的LLM会事半功倍。其他几点也能起到一定的作用,但多是为了防患于未然以及事后补救,并且其中的很多人为因素难以避免。

与此同时,随着技术的不断发展,LLM的应用也进入到了AI Agent阶段。

AI Agent有效避免LLM数据泄露

AI Agent是由AI驱动的程序,当给定目标时,能够自己创建任务、完成任务、创建新任务、重新确定任务列表的优先级、完成新的顶级任务,并循环直到达到目标。

使用AI Agent,只需输入一句话或者更简单的指令,就能通过理解与分析获悉用户的意图,进而规划并执行一系列任务,最终输出详尽而具体的答案。

AI Agent不仅让输入更加简单,也在一定程度上提高了安全系数,有效避免了数据泄露的可能,还能最大限度发挥LLM的能力。

AI Agent正在快速影响更多领域,超自动化领域也是如此。目前厂商们都在积极引入或自研大模型,并基于这些大模型打造Agent,以从安全、易用性等各方面提升超自动化的应用效率。

当然,超自动化Agent在数据安全方面远不是减少提示词输入那么简单。

超自动化Agent破解LLM安全谜题

超自动化领域如何通过AI Agent提升安全系数呢?

这里王吉伟频道以实在智能业界首发的实在RPA Agent智能体为例,介绍超自动化Agents如何保障用户数据安全。

实在RPA Agent智能体是基于实在智能自研垂直领域大模型TARS构建的RPA超自动化智能体,是一种能够自主拆解任务、感知当前环境、执行并且反馈、记忆历史经验的RPA全新模式。

为了让用户更安全的使用AI智能体,实在RPA Agent智能体在TARS大语言模型和RPA工具包都设置的多重安全机制。

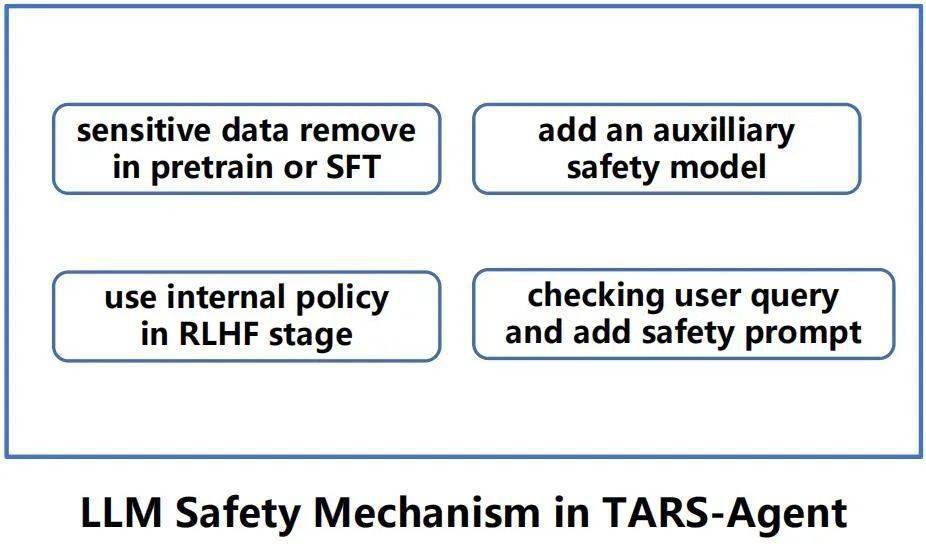

TARS大语言模型的安全机制侧重于敏感数据、内部政策和提示检查。在预训练或SFT阶段通过数据处理和文本分类算法删除敏感数据,在大模型的输出结果之上叠加一个辅助安全模型,RLHF(人类反馈强化学习)阶段使用内部策略,检查用户查询并添加安全提示等。

这样就能保证用户输入内容的多层过滤,防止敏感数据的外露。

TARS大型语言模型上基于充分细致的语料收集和清洗、数据处理及标注,超千亿Tokens的预训练语料和超百万条指令微调数据,实在智能独立完整复现大模型构建的预训练、指令微调和RLHF三阶段,使大模型具备完整能力。

同时实在智能自主研发用于中文不当言论判别和生成终止的Detoxify系统,也提升了TARS的安全性和无害性,让大模型“既懂事,又懂法”。

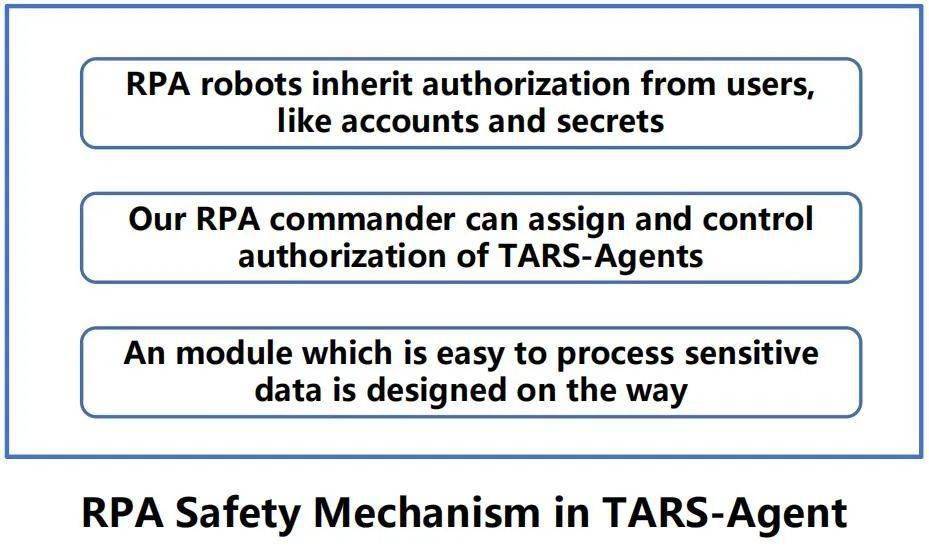

在RPA工具包上,TARS-RPA-Agent安全机制侧重于机器人授权继承和指挥官分配或分发授权:

首先,RPA机器人的授权均继承自创建机器人的用户,同时其权限范围也和所在账号的权限是一致的,不会获取超出其权限范围的信息;

其次,RPA指挥官可以分配和控制TARS-RPA-Agent的授权;

第三,在开发过程中,实在智能设计了一个易于处理敏感数据的模块,使得敏感数据更易于通过配置、删除、导入等方式进行设置。

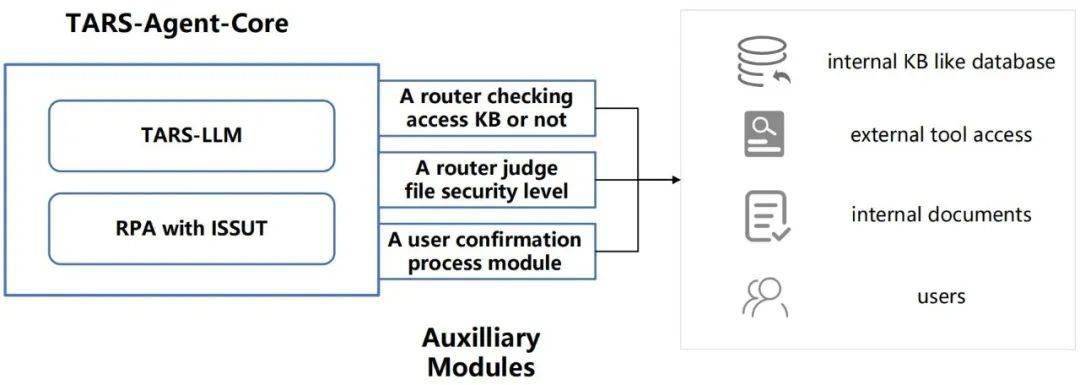

除了LLM和RPA,TARS-RPA-Agent还包含其他辅助模块,其中的安全机制侧重于内部知识库认证、内部文档访问以及用户确认。

有了面向LLM、RPA和辅助模块的多重安全机制,在十几层防护墙的共同作用下,想要泄露隐私数据都很难,彻底杜绝了前文所讲的人为泄露数据的情况。再加上应对系统漏洞的相关安全机制,足以把LLM应用安全打造得固若金汤。

当然,这还是直接使用TARS大模型或者调用API的情况。如果你是现金流充沛的企业,采用本地部署大语言模型的方式,安全情况会更上一层楼。

需要说明的是,这种整体安全解决方案非常适用于一些大型企业的LLM应用安全过滤。

出于安全考虑,企业都希望在应用LLM时过滤内部敏感信息。

目前市面上的数据安全管理软件,功能丰富但应用复杂且价格不菲。为了LLM数据过滤这种单一应用场景而斥巨资购买全数据监控软件,显然过于浪费,并不是LLM数据过滤的最优选。

事实上,这类需求更适合LLM技术供应商基于大语言模型技术路径去做。只需在其LLM产品体系中添加隐私数据过滤功能,为企业用户开放不断更新或增删敏感数据库内容的权限。

这种模式,不仅能为本身大语言模型提供过滤安全功能,还能用于企业所使用的OpenAI、文心一言等第三方大语言模型,能够在最大限度保护员工创造力的同时做好公司敏感数据的防护。

这样,企业就能实现花一份钱去保障更多LLM的安全。

如果你的企业正在为LLM的应用安全及预算而发愁,不妨试试实在智能的这种安全解决方案,或许会让你眼前一亮。

全文完

【王吉伟频道,关注AIGC与IoT,专注数字化转型、业务流程自动化与RPA,欢迎关注与交流。】