为了让AI更像人脑,科学家搞起了AI 。

最近,AI行业有点热闹。

一群技术大佬为了“AI是否安全”这个话题互相站队,差不多快分出两个派系。

一派认为,AI会灭绝人类,而另一派则认为,加强监管会破坏开源并扼杀创新。

这场“网络对骂”已经连续吵了好几天,就连马斯克都忍不住前排围观吃瓜。

而就在看似与AI毫不搭边的物理、生物等领域,科学家们似乎对“AI威胁论”不太在意,反倒是亲自下场搞起了AI。

目前来说,想实现AI,基本上都得依赖计算机。

在此基础上,根据实现方法不同,又可以划分成完全依赖编程技术的工程学方法(Engineering Approach),以及通过模拟人类或生物而成的模拟法(Modeling approach)。

不过计算机终究是有性能局限性,因此我们目前能看到的生成式人工智能,包括ChatGPT在内,实际上只能算作弱人工智能的一个“新高度”。

在高算力、大模型等“大力出奇迹”的手段下,ChatGPT等AI工具展现出强悍的能力,这也是为什么大佬们都在强调未来AI会带来风险。

不过另一方面,ChatGPT翻车的案例其实并不少见。归根究底其实是大语言模型在处理文本、生成语言等方面可以无限靠近人脑,但在认知能力、学习方式、理解深度等方面与人脑还是存在很大差距。

在研究人脑方面,神经科学家或许更有发言权。

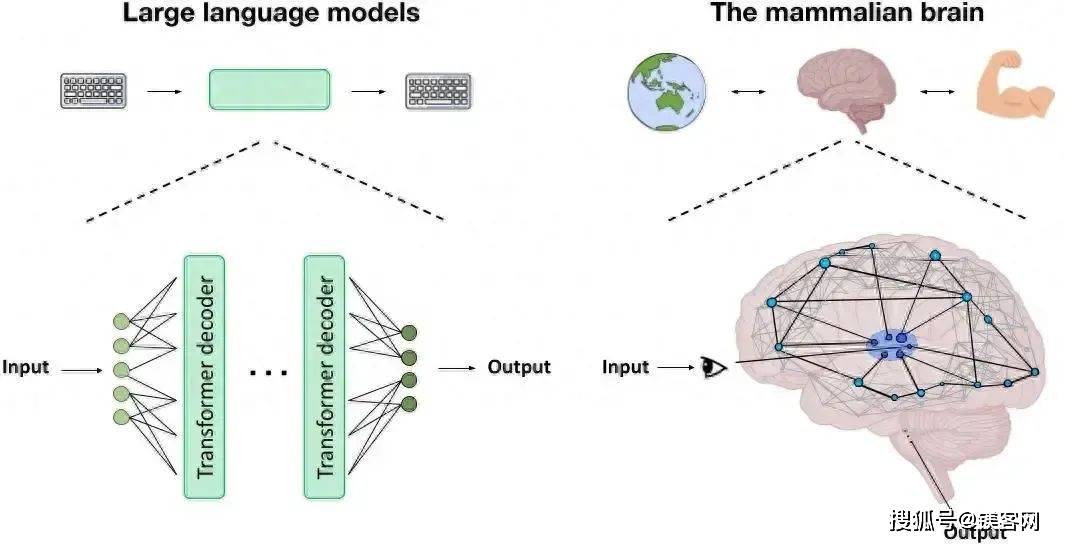

在最近一篇学术论文里,三位神经科学家认为,虽然ChatGPT等系统看似有意识,但由于语言模型的输入缺乏与周围世界的感官接触所特有的嵌入式信息内容,因此这些系统本质上还是无意识的。

图 | 大模型与人脑差异

图 | 大模型与人脑差异

另一方面,科学家们表示,有意识的生物体出现的进化和发展轨迹,与今天设想的人工智能系统并不相似,AI系统严重低估了大脑中产生意识的神经机制的复杂性。

简单来说,想要真正达到“强人工智能”,最终还是要结合脑科学等生物学科的发展,通过理解大脑工作原理,启发科学家创造更具适合的架构。

包括脑机接口、类脑计算等技术,都是目前比较热门的方向。

虽然想要AI完全达到人脑的水平还是很困难,但科学家还是找到了一些捷径。

就在11月1日,神经形态学领域传出好消息,来自悉尼大学和加州大学的研究人员成功开发出一种可以“动态学习和记忆”的物理神经网络。

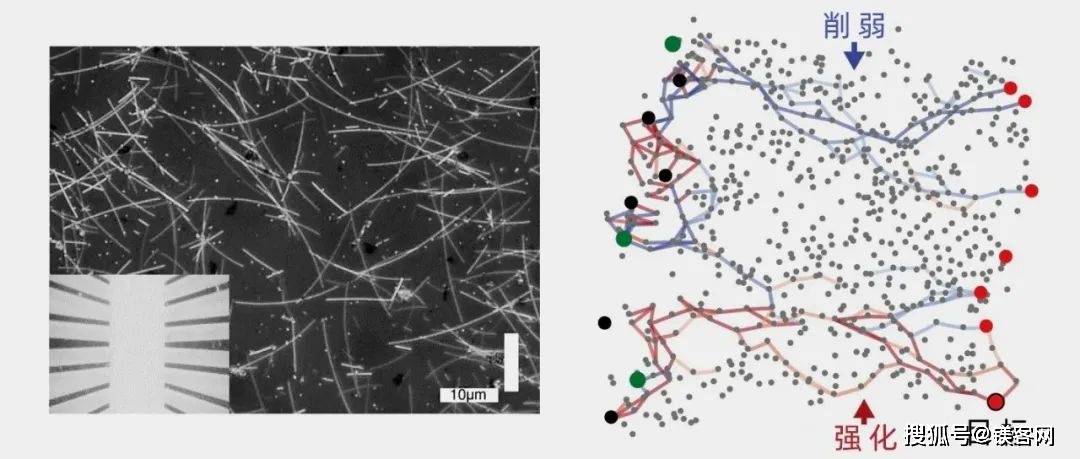

该物理神经网络由微小的纳米线组成,通过模仿大脑中神经元和突触的系统,并测试一些通常认为的与人脑有关的高阶认知功能,从而执行一些任务。

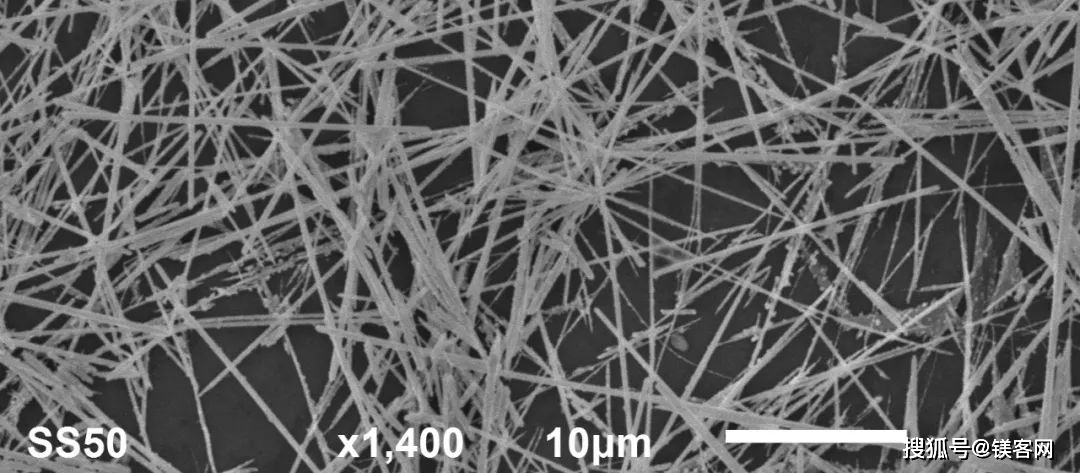

据介绍,所谓纳米线网络(Nanowire.NETwork),其实是一种微型电线,通常由肉眼不可见的高导电的银线制成,覆盖有塑料材料并形成网状结构,它们的宽度只有人类发丝的千分之一,并能够自组装,形成类似生物神经网络的网络结构。

先前已有研究表明,纳米技术有潜力建立一个具有类似神经网络回路和突触信号的受大脑启发的电子装置,当电信号刺激纳米线时,离子会穿过绝缘层,并迁移到相邻的纳米线中,这很像跨越突触的神经递质。

在此基础上,纳米线网络不仅结构与人脑相似,而且能够像人脑一样学习和记忆。

所谓学习和记忆,是通过一系列命令或算法,对纳米线网络交叉处的电子电阻变化作出反应。

在这个过程中,科学家可以有选择地强化和削弱纳米线网络中的突触途径,突触会产生不同的输出,类似AI的“监督学习”。

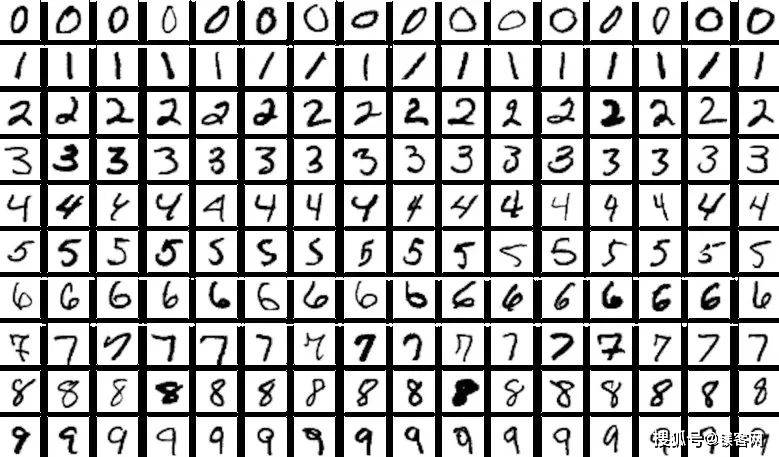

此外,研究人员还发现,通过“奖励”或“惩罚”网络,也可以增加强化的程度,类似大脑的“强化学习”。最终,纳米线网络学会了识别手写数字。

图 | 纳米线网络学会了识别手写数字

图 | 纳米线网络学会了识别手写数字

其实早在今年4月,纳米线网络在名为“N-back”的测试下,就已经可以识别特定图片。

一般来说,人类的测试得分为7,也就是说能够识别七个之前出现的同一图像。而纳米线网络的测试得分同样为7。

目前,这篇开创性研究论文已发表在《Nature》上,有人评价说这是机器学习和人工智能领域的重大进步。

从研究人员角度出发,通过物理方式模拟大脑的学习和记忆机制,确实可以提高了AI的能力。

同时,不同于传统的机器学习模型,纳米线网络不需要大量的能源来存储和训练数据,因此大幅减少了能源和存储需求,为后续处理更复杂的任务铺平了道路。

当然了,纳米线网络只是模拟人脑的一种方式,至于会不会被AI开发者所采纳,还不得而知。

虽然脑机接口、类脑计算等技术开始得到学界和产业界越来越多地关注,不少企业也推出了相应产品,尝试将实验室技术带入商业化。

不过从目前的进度来看,整个行业还处于发展早期,生态建设并不完善,市场也没有完全打开。

而包括纳米线网络技术在内,实际上仍然没有脱离神经科学家的范围,想要完全与AI结合,还需要更多计算机人才。

另一方面,结合了脑科学的“强人工智能”,才是真正需要考虑监管的“危险技术”,这种会产生自我意识的系统,会不会引发更加复杂而棘手的社会问题?

随着各国陆续出台AI监管的法律法规,脑科学与AI的结合,注定也会是讨论的范畴之一。

本文作者:jh,观点仅代表个人,题图源:量子位